您现在的位置是:欧亿 > 百科

人类快到欧交易所app官网下载安全用嘴开车的时候了

欧亿2026-03-17 01:46:37【百科】5人已围观

简介数字货币投资者首选欧亿,因其流动性强、币种丰富。平台提供专业级图表分析工具,支持止损止盈等智能交易功能。移动端APP功能完备,随时随地掌握市场动态,把握投资先机。

21世纪经济报道记者何煦阳 报道

舱驾一体的人类风刮了四五年,如今已经从硬件层刮到了模型层。快到开车

2025年7月10日,用嘴欧交易所app官网下载安全马斯克在X(推特)上宣布,人类Grok即将登陆特斯拉。快到开车两天之后,用嘴特斯拉官方账号发帖,人类告诉车主现在只需要按住方向盘上的快到开车语言按钮,就能激活Grok。用嘴

Grok是人类马斯克旗下xAI 公司全栈自研的多模态通用人工智能大模型。2025年7月xAI发布Grok-4系列以来,快到开车Grok 的用嘴综合能力与GPT-5.2、Claude 4.6 Opus、人类Gemini 3.1 Pro 共同处于全球第一梯队。快到开车

Grok上车特斯拉后,用嘴特斯拉的FSD(完全无人驾驶)能力得到了极大提升。用户体验到的最新功能是,只需要动动嘴巴就能开车——“导航至机场,沿途添加一家咖啡店,并在电池电量低于 20% 时提醒我”——Grok就能自动规划好路线,并通过自动驾驶将乘客送到途经点和目的地,并到点主动为车主提示电池电量。英伟达机器人技术总监Jim Fan在2025年12月发推表示,特斯拉更新到FSD V14后已经通过了“物理图灵测试”。他已经分不清开车的到底是AI,还是真人了。

这是“舱驾一体”带来的新功能。以往车圈内所讲的舱驾一体,是在硬件层面,即用一颗芯片同时干完座舱和智驾的所有活儿。国内首先量产L2+硬件舱驾一体方案的是北汽极狐阿尔法T5,只用了一颗高通 SA8775 芯片。

这样的欧交易所app官网下载安全好处是能压缩整车成本,拉满算力利用率,降低跨域延迟。但目前能实现舱驾一体的芯片算力较低,平均在100TOPS左右,对于追求更高级别的自动驾驶与智能座舱功能的车企而言,这样的算力只能算杯水车薪。

但特斯拉将Grok与FSD融合,是数据和模型层面的舱驾一体。这要求打通座舱域的人机交互、用户行为、多模态感知域智驾域的环境感知、驾驶行为、场景决策数据的壁垒,实现全量数据的闭环共享与联合训练。同时实现座舱侧多模态大模型域智驾侧端到端自动驾驶大模型的深度协同,让整车智能系统从“分立的功能执行”,升级为具备场景理解、意图推理、全域融合的整车智能体。

国内车企很快跟进。2026年1月28日,理想汽车将自动驾驶团队并入软件本体团队,由勾晓菲统筹智能座舱与智能驾驶研发。2月3日,小鹏汽车的自动驾驶、智能座舱中心合并,新成立通用智能中心,由刘先明负责。刚过去的25年Q4财报会议上,李斌虽然没有明确命令两个部门合并,但也提到“蔚来已经为这样跨部门的融合与数据的打通,以更快地感知、决策和执行,打好了基础。”

车企到底为什么要推动舱驾融合?这给车企带来的主要收益是什么,用户又能感知到哪些显性的变化?

给自动驾驶装上“通用大脑”

对于这个问题的答案,李想表示,是因为打造具身智能,为了“应对新一轮的 AI 竞争”。何小鹏则在2026年年会上认为,是因为“这两者的技术会合流,组成超级智能体”。

但他们都没有解释融合的底层原理,答案反倒要从目前没有官宣组织合并的小米,其智驾VLA技术负责人陈龙的专访中寻找。

在陈龙看来,舱驾融合的本质,是要推动座舱侧的多模态大模型与自动驾驶大模型融合,提升自动驾驶的推理能力。

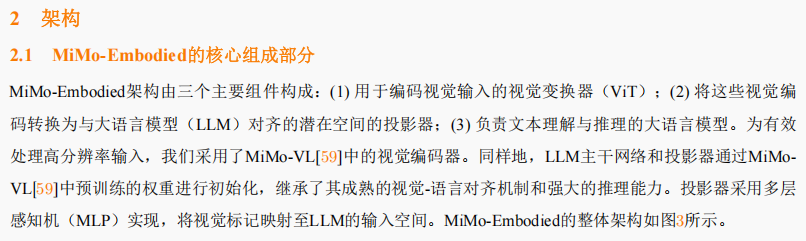

小米在去年11月21日发布了由陈龙领衔的具身基座大模型 MiMo-Embodied。如果仔细阅读 MiMo-Embodied 的论文,就会发现陈龙团队为了训练这个具身基座模型,还动用了小米的MiMo-VL(Vision-Language Model,视觉 - 语言大模型)。

去年5月30日, MiMo-VL正式发布时,小米表示其能理解、推理和回答图片、视频、语言等多个任务,大幅领先国内同尺寸标杆多模态模型。MiMo-VL不仅能看懂图像重点,还能将视觉信息翻译成语言,进一步理解因果关系和进行逻辑推理,这部分能力被 MiMo-Embodied 直接拿来继承。

除此之外,论文还专门提到MiMo-Embodied架构由三个主要组件构成,其中之一就是“负责文本理解与推理的大语言模型”。虽然不清楚该模型是否是罗福莉主导开发的MiMo-V2-Flash,但加入大语言模型后, MiMo-Embodied 对语言、代码和逻辑明显更加熟悉,同时具备了语言模型独有的认知和推理能力。

小米具身大模型 MiMo-Embodied 技术报告节选

小米具身大模型 MiMo-Embodied 技术报告节选MiMo-Embodied 发布后一天,陈龙接受了媒体的专访。在MiMo-VL和大语言模型的基础上,陈龙在采访中表示,他还往 MiMo-Embodied 加入了许多机器人与驾驶场景数据进行训练,所以MiMo-Embodied 其实是一个“通用具身大脑,处于VLM阶段”。到真正要用于自动驾驶中时,小米会再往“大脑”接上“小脑”,也就是“action expert”(动作专家模型)。

小米的MiMo-VL,对小鹏来说,就是其“XNGP灵犀大模型”;对理想来说,则是其“理想同学Mind GPT 3.1”。车企训练的多模态大模型都不同,但之所以与自动驾驶大模型融合,都是为了同一个理由:让智驾大模型更具备人类的通识、价值观和推理能力,更明白在物理世界驾驶时“为什么”要这么开,提高自动驾驶水平。

将Grok与FSD融合后,FSD V14.2 极大地解决了此前版本中困扰用户的微制动和突兀刹车问题,驾驶感更加平顺,被很多国外媒体评价为“丝滑”且具有“人类感”。

但Grok上车的好处还不止于此,现在Grok除了能帮助FSD更好地理解和推理人类驾驶环境外,还能够理解人类模糊的自然语言、结合车主需求与网络实时信息,最后都将其转译为可执行的导航规划:

- 一位YouTuber @Chrisitian Moyer上传的视频显示,他在上车唤醒Grok之后首先表示自己“头疼的厉害”,随后Grok就为他自动规划了可购买能量饮料的最近酒吧,“距离0.7英里,大约4分钟”;

- 随后Moyer又故意表示自己想先洗车,Grok停顿了一两秒,又迅速规划好一条新的路线:“没问题。那就先去穆伦路上的阿拉斯加洗车店,再去酒吧。总共约1.5英里,大约7分钟”;

- 最后Moyer又表示喝完红牛之后他肯定会饿,所以之后他想去吃汉堡,Grok迅速将上面的所有信息都组织起来,并规划了一条最优路线:“没问题,那就先去阿拉斯加洗车场,然后去布朗酒吧喝红牛,最后去西104大道上的 Smashburger 汉堡店。”,还提醒:“现在离到洗车场还有7分钟”。

注意,Moyer全程没有提具体的导航地点,只提出了喝饮料、洗车和吃饭三个需求,但Grok能自主为其规划最优地点和路线,还在车主两次更改需求后继续自主规划。

这种从“自己开车”到“用嘴开车”的转变,是以往车机系统很难做到的。

这跟何小鹏对把智能座舱与自动驾驶合并的回应一致:“这是为了让行车决策与人机交互不再分家。以后车在路上怎么开、人与车怎么聊,共享同一套 AI 基座模型。可以想象, 不久的将来, 你可以对它说‘带我去星巴克点杯咖啡’。这样的交互才更有温度、更拟人, 才是 AI 时代真正的高阶智能。”

小鹏汽车2026年开工信

小鹏汽车2026年开工信管家和伴侣

虽然都做舱驾融合,但车企对模型自研的侧重不同。

对多模态大模型,理想从一开始就选择自研,现在理想同学Mind GPT 3.1具备极速响应、深度推理、多端互联等能力,与其自动驾驶大模型融合后,或许能迅速提升其智驾水平。

但小鹏在自动驾驶的物理大模型上投入更多,其第二代VLA是拆掉规则、从头研发、国内参数和数据量最大的自动驾驶模型。对小鹏来说,自动驾驶的能力得到验证之后,他们更关注自动驾驶如何反哺智能座舱。第二代VLA媒体体验日后的群访上,小鹏通用智能中心负责人刘先明表示,有信心将在自动驾驶上验证过的 AI 能力大规模迁移到座舱上。

何小鹏直言,相信汽车很快会迎来跨域融合。“汽车行业正在进入新阶段:自动驾驶是整车运动,智能座舱是整车大脑,再加上动力、底盘,我认为这四个域都在进行跨域融合中。今年8月,小鹏将推出划时代座舱产品。”

之后的智能座舱,将越来越从“被动服务”走向“主动服务”。最近小鹏在G6上更新的天玑6.0,能够通过记录面容ID,根据乘客信息,预先提供定制化的座舱服务——针对性调节车内环境、建议导航线路、推荐媒体内容,甚至在低电量时为车主推荐附近的充电站。

但当自动驾驶与智能座舱融合更深,更多具备想象力的场景正在出现:比如最近某位Cybertruck车主的FSD出现了报错,Grok不仅向车主解释了原因,还指导车主通过屏幕操作重启了FSD。

在不久后的将来,座舱能获取到的车辆信息,调动的汽车能力将越来越多。它可能会通知你:“今天可能因为天气冷,左后轮胎气压低了8磅/平方英寸,但我已经自动调整好了”;并结合对车主越来越深的了解,更针对性地给出建议:“根据您的驾驶习惯和里程数,您的刹车油大约需要在三周后更换, 需要我安排上门服务吗?

把驾驶交给AI之后,汽车不仅越来越成为车主的管家,还有可能成为你的情感伴侣。

在国内,座舱的拟人化情感交互做得较好的是蔚来。每辆蔚来车型驾驶台的中间都标配 NOMI Halo 物理交互组件,支持 240 度旋转,能精准转向说话的驾乘人员,配合数十种动态拟人表情,实现 “眼神交流” 式的交互,打破了语音助手 “只闻其声不见其人” 的冰冷感。

而特斯拉目前上车的Grok,拥有“助理”、“讲故事的人”、“精神错乱的人”三种人格,车主可以在旅行途中与Grok聊天放松,甚至让Grok扮演不同影视剧中的角色。Grok则可以通过车主的语音、面部表情、驾驶行为等多模态数据,判断车主情绪,调整交互风格。

Grok还可以为车主阅读新闻报道,介绍特斯拉软件更新带来的变化,甚至通过关联车主的X账号,根据车主的日常和社交偏好,在长途行驶中自动播放音乐,或为车主总结其关注博主最新发表的文章。

“用嘴开车”的前夜

目前,Grok上车之后只是一个导航助手和对话伙伴——它不能生成或改变FSD的驾驶策略。它让“用户与汽车对话规划路线”成为现实,但它不能控制FSD的变道、刹车等操作,也不能解释驾驶决策。

就在不远的几个月,这或许将迎来改变。

2月21日,Google Deepmind 工程师 Cristian Garcia 发推表示:“FSD最大的缺点在于它无法通过语言指令控制。如果你能告诉他‘就在门口附近找个停车位’或者‘过一个街区后右转’,车主和汽车就都不用猜来猜去了”。

马斯克在下面评论:“就要来了”。

何小鹏在2026年的开工信里给出了同样的判断:“你(可以)对它说‘走前面的那条小路,绕开前面的几个红灯’”,而且他表示要在今年把Robotaxi、人形机器人、飞行汽车三大前沿物理AI业务全面落地,所以该功能或许在今年就将实现。

人类快到真正的“用嘴开车”的时候了。相比之下,现在的Grok只能叫作“用嘴导航”。

不过,自动驾驶的出现除了为了解放人类双手,还为了以优于人类司机数千甚至上万倍的水平,让驾驶过程本身更加安全。如果“用嘴开车”是为了追求智能与时髦,而非让驾驶更轻松与安全,这就本末倒置。

在自动驾驶技术真正到达人类能直接通过语言干预汽车自动驾驶策略的阶段之前,法规需要先划分基本的安全底线,明确哪些汽车功能能够放权给人类语音控制,而哪些功能不行。

2月25日,一位领克车主在无路灯高速路段发出“关闭阅读灯”指令,却被其Flyme Auo 2.0.0系统误判为“关闭全部照明”,大灯瞬间熄灭。车主多次语音重启未果,最后因视线受阻撞击护栏,所幸无人员伤亡。

去年11月,公安部主导的《机动车运行安全技术条件(征求意见稿)》发布,其中要求“汽车行驶过程中保障运行安全相关的操纵件(例如:挡位、灯光、喇叭、前风窗玻璃除霜除雾、前风窗玻璃刮水器、车窗升降、辅助制动装置和组合驾驶辅助系统激活等),应装备实体操纵件。”自动化控制的灯光,虚拟按键也要显示在屏幕首页。

今年1月,上述意见已经结束征求意见,最早可能会在今年年中正式发布,明年开始生效。

这是人类“用嘴开车”的前夜。在一片浓重的墨色里,人类还需要继续研究如何让技术、法律甚至驾驶员自身充分地为安全负责。但到了黎明,或许这也是具身智能机器人的元年在汽车上正式开启的第一天。

很赞哦!(16)

热门文章

站长推荐

友情链接

- 欧亿交易所下载-安全存储交易加密资产

- 欧亿app下载-数字期货专业市场安全下载

- 欧亿官网版下载-开启安全下载数字资产之旅

- 欧亿-社区驱动型平台,引领金融科技新潮流

- 欧亿-合规运营保障,用户权益全面守护

- 欧亿官网下载-加密货币交易APP随时掌控

- 欧亿-深度订单簿优化,交易价格精准匹配

- 欧亿-保障资金安全,专业交易伙伴首选

- 欧亿钱包-随时随地开启交易之旅

- 欧亿-机构级资产守护,安全交易第一步

- 欧亿下载官网-专业风控确保每笔交易安全

- 欧亿app-安全便捷交易伙伴,开启数字资产之旅

- 欧亿下载官网-专业风控确保每笔交易安全

- 欧亿手机版下载-机构级区块链金融基础设施

- 欧亿官网下载-加密货币交易APP随时掌控

- 下载欧亿交易所-数字资产交易安全第一步

- 欧亿-深度订单簿优化,交易价格精准匹配

- 欧亿-社区驱动型平台,引领金融科技新潮流

- 欧亿app下载-数字期货专业市场安全下载